Demain, nous serons tous des Datacenters

Ce matin, avant le café, deux IA m'avaient déjà mâché le travail.

Marcel — mon assistant personnel, bâti sur OpenClaw, qui tourne sur une VM Azure — m'a envoyé un point domotique sur Telegram. Alarme bien activée, lave-vaisselle terminé, maison verrouillée. Le genre d'infos que j'allais chercher dans trois apps différentes il y a un an. Aujourd'hui, Marcel me les pousse avant que je les demande.

Côté boulot, c'est Copilot qui a pris le relais — résumé des mails de la nuit, briefing des réunions du jour, suggestions de réponses. Deux IA, deux usages. L'une personnelle, qui envoie chaque requête à un modèle hébergé dans un datacenter. L'autre professionnelle, intégrée à Microsoft 365. Les deux passent par le cloud. Les deux fonctionnent.

Mais combien de temps cela restera nécessaire ?

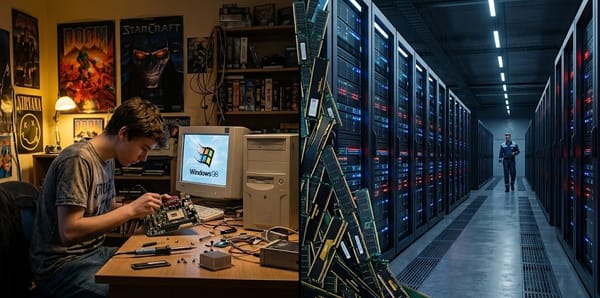

Il y a trois ans, la question ne se posait pas. GPT-4 nécessitait 25 000 GPU A100, 90 jours de calcul continu, plus de 100 millions de dollars d'infrastructure. L'IA était une affaire de datacenters. Exclusivement.

Le 2 avril, Google a sorti Gemma 4. Le modèle tourne sur un téléphone Android. Et sur un Raspberry Pi.

Entre les deux : 36 mois. Qu'est-ce qui s'est passé ?

Pour comprendre, il faut rembobiner. Et mesurer d'où l'on vient.

En 2023, faire tourner un modèle de langage, c'était comme faire tourner une centrale nucléaire. Ça nécessitait une infrastructure dédiée, une équipe, un budget colossal. GPT-4 a mobilisé 25 000 GPU A100 de Nvidia pendant 90 jours de calcul continu. Le coût d'entraînement estimé dépasse les 100 millions de dollars. L'entraînement de Gemini Ultra, le modèle le plus ambitieux de Google, a coûté près de 191 millions de dollars selon les estimations d'Epoch AI.

Et les puces qui faisaient tourner tout ça étaient elles-mêmes un goulet d'étranglement. Les GPU H100 de Nvidia se vendaient entre 30 000 et 40 000 dollars l'unité — quand on arrivait à en trouver. Pendant 18 mois, le monde entier s'est battu pour des wafers de silicium. Les files d'attente s'étalaient sur des trimestres. Les allocations étaient rationnées comme du pétrole en temps de guerre.

Pour un usage aussi simple que résumer un document ou classifier un email, il fallait passer par une API cloud, payer au token, envoyer ses données vers des serveurs distants. L'IA n'était pas un outil qu'on possédait. C'était un service qu'on louait — accessible uniquement via un navigateur ou une ligne de code. Personne n'imaginait faire tourner un modèle sérieux en dehors d'un datacenter.

C'était logique. C'était justifié. Et ça a duré exactement le temps qu'il fallait pour que quelqu'un prouve le contraire.

L'Edge computing — calculer au plus proche de la donnée, sur le terminal, sans tout rapatrier vers le cloud — existait depuis des années dans l'IoT et les véhicules connectés. Mais la puissance en périphérie suffisait pour détecter un mouvement ou compresser une vidéo. Pas pour raisonner. L'IA et l'Edge vivaient dans deux mondes séparés. L'un trop gourmand, l'autre trop maigre.

Et puis quelque chose a changé.

Non pas les machines — les modèles. La course ne s'est pas accélérée. Elle a changé d'axe : non pas en rendant les machines plus grosses, mais en rendant les modèles plus intelligents à taille constante.

Septembre 2023. Mistral, une startup française fondée par d'anciens chercheurs de Google DeepMind et Meta, sort Mistral 7B. Un modèle de 7 milliards de paramètres. Open source. Téléchargeable. Il rivalise avec GPT-3.5 sur de nombreuses tâches — résumé, classification, génération de texte. Et la communauté comprend un truc : la taille n'est pas le seul vecteur de performance. Un modèle bien entraîné, bien architecturé, peut faire mieux avec moins. C'est le premier choc.

Pendant ce temps, le reste de l'industrie ouvrait les vannes. Microsoft Research publiait la famille Phi — des modèles pensés dès le départ pour être petits et performants, entraînés sur des données synthétiques de haute qualité. Phi-3 Mini, 3,8 milliards de paramètres, tournait sur un smartphone et dépassait GPT-3.5 sur le benchmark MMLU. Meta open-sourçait Llama 3. Google publiait Gemma. Un framework appelé Ollama s'imposait comme le standard pour faire tourner un LLM en local — trois commandes, pas de configuration. Pour la première fois, n'importe quel développeur pouvait faire tourner un modèle capable sur son laptop, sans compte cloud, sans API, sans payer un centime. En mars 2025, Gemma 3 sortait avec cinq tailles de modèles, de 270 millions à 27 milliards de paramètres, multimodal, exécutable sur un seul GPU. Quand les hyperscalers eux-mêmes miniaturisent, c'est que la direction est confirmée.

Mai 2025, Microsoft Phi-4 Reasoning. 14 milliards de paramètres. Et le modèle rivalise avec des monstres 50 fois plus gros sur plusieurs benchmarks de raisonnement mathématique et scientifique — dont le DeepSeek-R1-Distill-70B sur AIME. Le ratio est vertigineux. Ce n'est plus une tendance. C'est un renversement.

Dans la foulée, Microsoft franchit un cap symbolique avec Phi Silica — un modèle embarqué directement dans les NPU des Copilot+ PC. Pas d'installation. Pas de téléchargement. Pas de cloud. L'inférence IA tourne dans le silicium de la machine, gravée dans la puce au moment de sa fabrication.

On n'installe plus un logiciel d'IA — on achète un PC qui en contient déjà un.

Le 2 avril 2026, Google DeepMind publie Gemma 4. Quatre tailles. Le plus petit — E2B, 2,3 milliards de paramètres actifs — tient dans 1,5 Go de mémoire. Il tourne sur Android et sur Raspberry Pi. Jusqu'à 4 fois plus rapide que la génération précédente, avec 60 % de consommation batterie en moins. Il traite du texte, des images et de l'audio nativement, directement sur le terminal.

Le plus grand — 31 milliards de paramètres, architecture dense. Ce modèle peut lui aussi tourner sur des milliards d'appareils Android.

Et le même jour , Microsoft annonçait trois nouveaux modèles MAI dans Foundry : MAI-Transcribe-1, le meilleur moteur de transcription vocale du marché sur les 25 langues les plus utilisées, 2,5 fois plus rapide que l'offre Azure existante. MAI-Voice-1, qui génère 60 secondes d'audio en une seconde. Et MAI-Image-2, déjà classé dans le top 3 mondial sur le leaderboard Arena.ai, qui propulse la génération d'images dans Copilot et bientôt PowerPoint.

Trois modèles maison, disponibles dans Foundry à des prix agressifs — et déjà déployés dans les produits Microsoft que des millions de gens utilisent chaque jour.

La stratégie n'est pas de choisir un camp. C'est de couvrir tout le spectre

En 36 mois, le curseur puissance/taille s'est déplacé d'un datacenter entier à la puce d'un téléphone. Ce n'est pas une réduction. C'est une transformation.

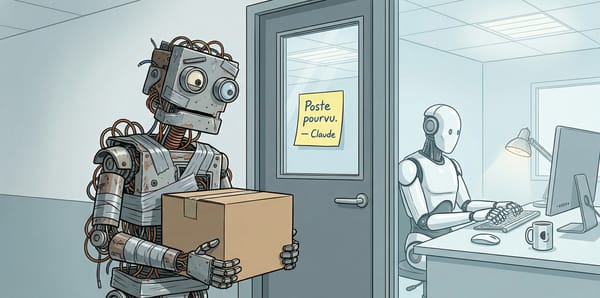

En février 2026, la montée en puissance d'OpenClaw et des modèles locaux a provoqué quelque chose d'inattendu : une pénurie de Mac Mini M4 chez Apple. Délais de livraison : 2 à 5 semaines selon les configurations. La demande était telle qu'Apple a annoncé la production de Mac Mini aux États-Unis, dans une nouvelle usine à Houston, Texas. Ce n'est pas un phénomène de geeks isolés qui s'amusent dans leur garage. C'est un signal de marché. Des milliers de développeurs et de professionnels tech achètent du matériel pour sortir leur IA du cloud.

Et Marcel ? Mon assistant qui tourne sur sa VM Azure, celui qui me dit chaque matin si l'alarme est bien en route ? Est-ce qu'il a vraiment besoin d'un aller-retour datacenter pour me confirmer que le lave-vaisselle a fini son cycle ? La question se pose.

Microsoft a d'ailleurs officialisé ce continuum cloud↔edge avec Foundry Local. L'inférence locale n'est plus un hack de développeur du dimanche — c'est une option architecturale reconnue et supportée. Le cloud ne disparaît pas. Il garde ce qu'il fait le mieux : l'entraînement, le fine-tuning, les workloads lourds, l'élasticité à l'échelle. L'edge prend ce qui a du sens en local : l'inférence du quotidien, la réactivité instantanée.

Et ça, ce n'est pas un hasard. Cette stratégie hybride — le meilleur du cloud là où il est indispensable, le meilleur de l'edge là où il fait sens — c'est exactement ce que Microsoft construit depuis des années.

Phi pour le small, Azure pour le scale, Foundry Local pour faire le pont. Ce n'est pas un pivot. C'est la suite logique d'une vision qui a toujours misé sur le fait d'aller chercher la puissance là où elle est la plus utile.

Nos Sufaces et Surfaces laptops embarquent déjà des NPU à 40–48 TOPS.

Ils font déjà de l'inférence locale — résumé, classification, génération d'images — sans qu'une seule requête ne quitte la machine.

Nos téléphones tournent des modeles capable de texte, image, audio. Sur le processeur. Sans connexion.

Nos voitures embarquent des puces de traitement neural — Tesla FSD chip, Qualcomm Snapdragon Digital Chassis. L'inférence IA dans le véhicule est déjà une réalité pour la conduite assistée. Le modèle ne consulte pas un serveur pour décider de freiner. Il décide. En local. En temps réel.

Nos montres portent des neural engines. Le prochain pas — l'inférence LLM sur poignet — est une question d'optimisation, plus de faisabilité.

Et en janvier 2024, Neuralink a implanté sa première puce chez un patient humain. On peut discuter des délais, de l'éthique, de la faisabilité à grande échelle. Mais le fait est là.

Le schéma est toujours le même. L'intelligence descend d'un cran. Du datacenter au serveur. Du serveur au PC. Du PC au téléphone. Du téléphone au poignet. Et peut-être, un jour, du poignet au cortex.

L'idée n'est d'ailleurs pas nouvelle. En 2004, IBM avait lancé le World Community Grid — la puissance de calcul inutilisée de millions de PC, agrégée via le logiciel open source BOINC, pour faire de la recherche humanitaire. Au pic, le réseau dépassait en puissance le superordinateur numéro un mondial. IBM appelait ça "a supercomputer of the people". L'intuition était la bonne. Mais les modèles étaient trop lourds, les réseaux trop lents, les terminaux trop limités. Aujourd'hui, ces trois verrous ont sauté.

J'appelle ça le gris de l'IA — par analogie avec le grey computing distribué. Non plus un datacenter central, ni même une flotte de serveurs edge. Une nappe d'intelligence diffuse, répartie dans chaque objet, chaque réseau, peut-être chaque être humain connecté. Pas de centre. Pas de périphérie. Juste un continuum de puissance qui s'infiltre partout, comme l'électricité l'a fait il y a un siècle — jusqu'à devenir invisible.

Si chaque device devient un nœud d'inférence, si chaque puce contribue à une intelligence collective — où s'arrête le réseau ?

Et surtout : sommes-nous prêts à devenir, nous aussi, des nœuds de ce réseau ?

Sources

- Google DeepMind — Gemma 4: Our most capable open models to date (2 avril 2026)

- Android Developers Blog — Announcing Gemma 4 in the AICore Developer Preview (2 avril 2026)

- WaveSpeed AI — What Is Google Gemma 4? Architecture, Benchmarks, and Why It Matters (2026)

- Sam Altman / Epoch AI — GPT-4 training cost estimation > 100M$ (2023)

- Epoch AI / Statista — Gemini Ultra training cost ~191M$ (2023)

- Mistral AI — Mistral 7B release (septembre 2023)

- Microsoft Research — Phi-3 Mini benchmarks, Phi-4 Reasoning vs DeepSeek-R1 (2024–2025)

- SiliconAngle — Phi-4 Reasoning 14B vs DeepSeek-R1-Distill-70B (mai 2025)

- Microsoft Learn — Phi Silica, NPU 45 TOPS, Copilot+ PC (2024–2025)

- Google DeepMind — Gemma 3: five sizes, 270M–27B, 128K context (mars 2025)

- TechRadar / Apple — Mac Mini M4 shortage, Houston factory announcement (février 2026)

- Barchart / TechRadar — OpenClaw driving Mac Mini demand (février 2026)

- Microsoft — Foundry Local, inférence on-device (2025)

- IBM History — World Community Grid launch (novembre 2004)

- BOINC / Linux Magazine — Puissance agrégée dépassant Blue Gene/L (2004–2005)

- Neuralink / presse — Premier implant humain (janvier 2024)