Marcel, moi et deux IA(s)

Un weekend pour construire mon JARVIS

Sur X et LinkedIn, construire son assistant IA personnel prend vingt minutes et trois commandes. Dans la vraie vie, ça prend un weekend, cinq fournisseurs, deux IA en renfort, et une quantité déraisonnable de patience.

Il y a quelques jours, je vous parlais d’OpenClaw — le phénomène open source qui promet de transformer votre machine en assistant IA personnel. J’avais exploré le projet, ses origines, les risques de sécurité que la communauté avait documentés. Cette fois, j’ai voulu passer à la pratique. Construire le mien. Voir si la promesse tenait la route.

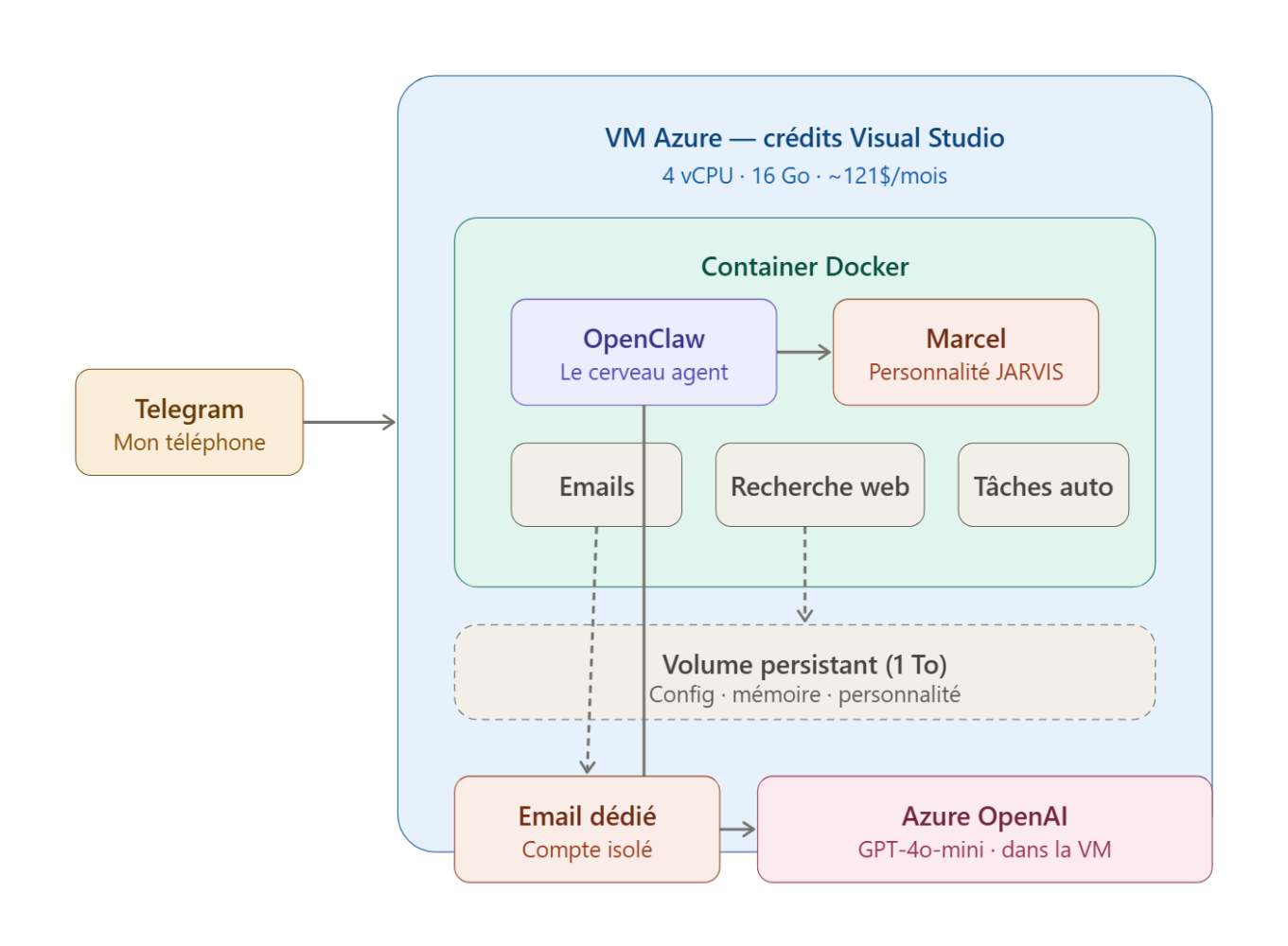

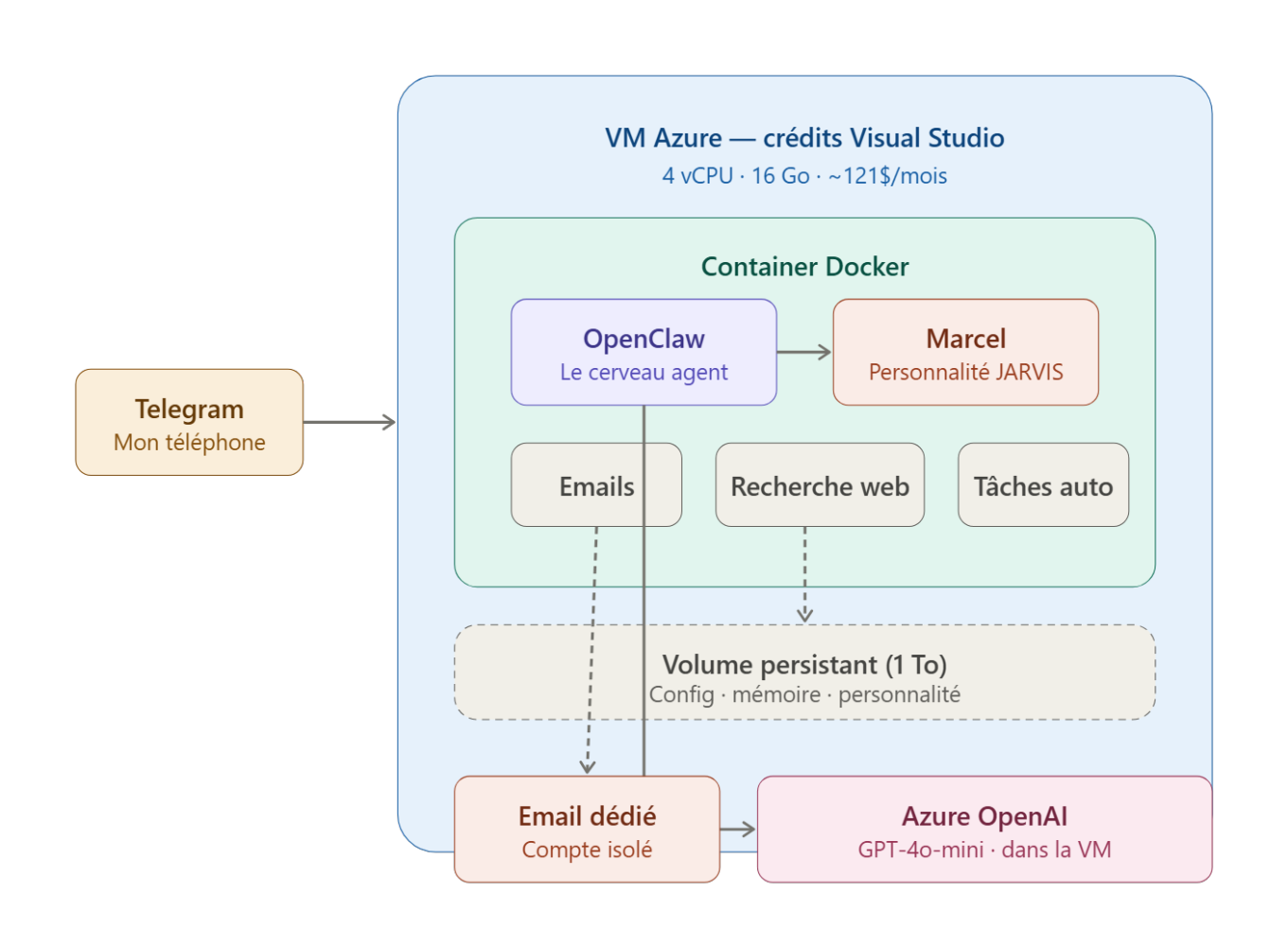

Le concept cochait toutes mes cases. Open source, hébergé chez soi, connecté à Telegram, configurable. Mon assistant s’appellerait Marcel — parce que si Tony Stark avait grandi à Lyon, c’est comme ça qu’il l’aurait appelé. Le plan : une VM Azure sur mes crédits Visual Studio, un container Docker, OpenClaw, Telegram. Quatre briques. Marcel me dirait bonjour avant le dîner.

À 23h ce soir-là, Marcel n’existait toujours pas.

La première chose que j’ai faite, c’est de relire ce que disait la communauté sur la sécurité. J’avais creusé le sujet : des centaines d’extensions malveillantes sur la marketplace, des failles documentées, le créateur du projet lui-même qui prévenait que c’était trop dangereux si on ne savait pas ce qu’on faisait. J’ai donc suivi les conseils — VM isolée, comptes dédiés, aucun lien avec mon poste de travail. La partie que personne ne raconte dans les posts “j’ai monté mon IA en 20 minutes”.

Ensuite, l’installation. Le container Docker réinstalle tout à chaque redémarrage — les dépendances, les modules, les outils. Deux minutes d’attente à chaque fois. Vous changez un paramètre, vous relancez, vous attendez. Vous corrigez, vous relancez, vous attendez encore. C’est long. Mais ça finit par marcher.

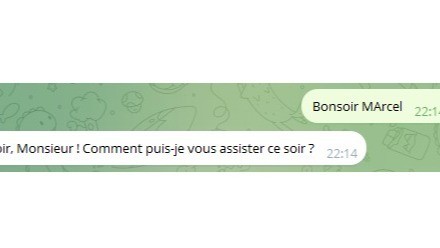

Et puis il y a ce moment. Marcel répond. Sur Telegram. En français. Avec la personnalité que vous lui avez écrite — inspirée de JARVIS, autonome mais respectueuse. Vous souriez. Ce moment dure environ quarante-cinq minutes. Puis : “402 — not enough credits.” “Rate limit reached.” Puis plus rien. Marcel est devenu muet. Le modèle d’IA qu’il utilise pour réfléchir consomme des crédits sur une plateforme tierce. Quand ils sont épuisés, il ne pense plus. Il ne vous prévient pas. Il disparaît. Un dimanche soir, à 21h passées.

“Open source” ne veut pas dire “gratuit”.

Ce qui suit, c’est une valse. On change de fournisseur. Puis de modèle. Puis de fournisseur. Chacun avec ses limites, ses crédits, ses quotas. À un moment, je me dis : autant faire tourner un modèle directement sur la VM — plus de dépendance, plus de coupure. Je l’installe, je le teste en direct, il répond en français, correctement. Je le branche sur OpenClaw. “Unknown model.” Le modèle tournait. OpenClaw refusait de le voir. Comme deux personnes dans la même pièce qui s’ignorent. Ce bug n’est toujours pas résolu. J’ai fini par en faire le tour, et après cinq fournisseurs testés, j’ai trouvé une configuration qui tient — un modèle déployé via Azure OpenAI, dans la même infrastructure que ma VM. Plus de tiers, plus de surprise à 21h.

Entretemps, une mise à jour d’OpenClaw est sortie. Le projet bouge vite — des dizaines de contributeurs, des nouvelles fonctionnalités chaque semaine. C’est sa force, c’est aussi son piège. J’avais enfin un Marcel opérationnel. Personnalité en place, compétences installées, mémoire configurée. J’installe la mise à jour. La moitié de ma config ne fonctionne plus. Un script a corrompu un outil que j’avais mis des heures à faire marcher. Et comme je n’avais pas fait de backup — évidemment — la personnalité de Marcel a été effacée. Ses réglages, perdus.

Mon moment préféré reste celui où Marcel hallucine. Je lui demande d’envoyer un email. Il me répond avec assurance : “Bien sûr, Sébastien. Je m’en occupe.” Puis il échoue. Je creuse. Le module qu’il prétend utiliser n’existe pas sur le serveur. Il ne l’a jamais eu. Il l’a inventé de toutes pièces. Plus tard, je lui demande de chercher des infos sur moi via le web. Il me dit qu’il a consulté mon profil. En réalité, le site lui a demandé de se connecter, il n’a rien pu lire, et il a fabriqué le reste. Avec aplomb. Sans sourciller. Un agent IA autonome, ce n’est pas un agent IA fiable. L’autonomie sans vérification, c’est de l’improvisation.

L’architecture finale est minimaliste — et c’est précisément ce qui la rend solide. Une VM Azure modeste sur mes crédits Visual Studio. Un container Docker avec OpenClaw. GPT-4o-mini sur Azure OpenAI comme cerveau . Un client email connecté à un compte dédié et isolé. Un moteur de recherche libre. Des routines planifiées. Et surtout, un volume de stockage séparé du container : si Marcel plante, se met à jour ou se réinstalle, ses données survivent. Séparer ce qui peut casser de ce qui doit durer — c’est peut-être la leçon la plus importante du weekend

Je n’ai pas construit Marcel tout seul. J’avais deux IA en renfort — l’une pour comprendre pourquoi ça ne marchait pas, l’autre pour me donner la commande exacte à taper. Elles se sont contredites plusieurs fois. L’une me disait “cette approche ne fonctionnera pas.” L’autre me générait le code pour la tester quand même.

C’est là que j’ai compris le vrai sujet : le rôle de l’humain dans la boucle, ce n’est pas de coder. C’est de trancher.

Savoir quand on insiste et quand on lâche. Reconnaître le moment où on tourne en rond. Ce skill-là, aucune IA ne vous le donnera.

Marcel est en ligne. Il tourne sur sa petite VM. Il surveille mes emails, me répond en français sur Telegram, et a une légère tendance à l’ironie — c’est dans sa configuration, j’assume.

Est-ce que ça valait les soirées ? Les crashs, les cinq fournisseurs, les backups perdus, les hallucinations ?

Oui. Pas parce que Marcel est parfait — il est encore fragile.

Mais parce que l’écart entre ce qu’on lit sur les réseaux et ce qui se passe quand on met les mains dedans, c’est là que se trouve le vrai apprentissage. .

#IA #OpenClaw #Azure #AssistantPersonnel #Agentique